Трамп и гонка технологий ИИ

Победа Трампа вызвала в мире достаточно противоречивые эмоции — от воодушевления до тревоги. Это относится и к проблеме ИИ, ибо Трамп признал, что во время своей избирательной кампании успешно использовал ИИ как для разработки своей политики, так и для написания речей, постов и т.д. В этом контексте победа Трампа способна непредсказуемо изменить не только политический ландшафт мира, но и всю сферу ИИ – одного из самых прорывных продуктов ИКТ.

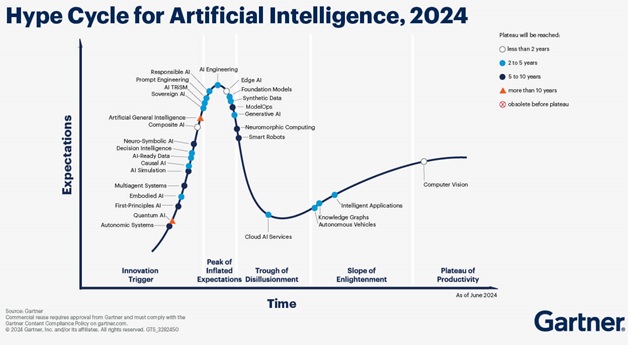

Наиболее убедительно данный феномен технологий ИИ показывает один из самых авторитетных источников — кривая ожиданий Гартнера, в котором системы ИИ занимают в 2024 году самые высокие позиции.

Агентство Gartner представило список из 10 стратегических трендов и на 2025 год, в которых системы ИИ также занимают лидирующие позиции:

- «агентский» ИИ(Agentic AI). Подразумевается использование систем ИИ, способных самостоятельно планировать и выполнять действия для достижения поставленных пользователем целей. Ожидается, что к 2028 году не менее 15% повседневных рабочих решений будут приниматься ИИ-агентами;

- платформы управления ИИ(AI Governance Platforms). Имеются в виду инструменты для управления и контроля за применением ИИ, чтобы обеспечить его этичное и ответственное использование. По прогнозам, к 2028 г. компаниям, внедрившим такие платформы, пользователи будут доверять на 30% больше;

- защита от дезинформации(Disinformation Security). Речь идет о создании систем, способных обеспечить точность информации, проверить ее достоверность, предотвратить кражу личности и контролировать распространение опасного контента. Ожидается, что к 2028 г 50% компаний начнут внедрять решения для защиты от дезинформации;

- постквантовая криптография(Post-quantum Cryptography). Имеются в виду криптографические методы, способные обеспечить защиту от новых угроз, связанных с квантовыми компьютерами. Аналитики ожидают, что к 2029 г. успехи в квантовых вычислениях сделают асимметричные системы шифрования небезопасными;

- невидимый окружающий интеллект(Ambient Invisible Intelligence). Использование незаметных человеку и недорогих датчиков для отслеживания расположения в пространстве различных объектов, передачи данных о них в облако;

- энергоэффективные вычисления(Energy-Efficient Computing). Разработка и использование компьютеров, дата-центров с низким потреблением энергии;

- гибридные вычисления(Hybrid Computing). Одновременное применение разных типов вычислений: CPU, GPU, интегральных схем специального назначения (ASIC), облачных вычислений, нейроморфных, квантовых и фотонных систем;

- пространственные вычисления(Spatial Computing). Достижения в области дополненной и смешанной реальности (AR, MR), а также ИИ позволят создавать иммерсивные среды в играх, здравоохранении и E-commerce. К 2033 г рынок пространственных вычислений достигнет $1,7 трлн;

- многофункциональные роботы(Polyfunctional Robots). Роботы, способные выполнять разнообразные задачи, следуя указаниям человека или его примеру. Это гибкие устройства по функциям и управлению;

- нейрологическое улучшение(Neurological Enhancement). Технологии, направленные на улучшение когнитивных способностей человека за счет считывания и декодирования мозговой активности, а, возможно, и прямого внесения информации в мозг.

Свои, также позитивные прогнозы на треке ИИ представили другие известные центры, в том числе Accenture, McKinsey&Company, GitHub, Центр безопасности и новых технологий Джорджтаунского университета (CSET), а также эксперты Стэнфорда.

По мнению специалистов, перспектива создания общего ИИ (AGI) кажется вполне возможной во время второго срока Трампа, что вызывает острые дискуссии и, даже, полемику о возможных последствиях его создания. 22 декабря 2024 года Трамп назначил известного эксперта Шрирама Кришнана старшим политическим советником по вопросам ИИ. Роль Кришнана приходится на критический момент, когда ИИ все больше влияет на геополитику, глобальную конкурентоспособность и экономическое развитие. Он будет работать с Дэвидом Саксом, бывшим главным операционным директором PayPal и кандидатом Трампа на пост руководителя политики Белого дома в области ИИ и криптовалют.

Данное обстоятельство заслуживает особого внимания, ибо с учетом влияния избранного вице-президента Джей Ди Вэнса и инвестора Илона Маска, внедрение AGI может состояться намного быстрее. Причин для такого утверждения немало. Трамп исторически выступал за ограничение госрегулирования ИИ. Он считает, что ИИ помогает повысить конкурентоспособность США, особенно относительно Китая. Так, Трамп еще в 2019 г. подписал указ о содействии развитию ИИ.

Ряд влиятельных лиц в индустрии ИИ считают, что отмена Указа Байдена о регулировании ИИ от 30 октября 2023 года способна открыть рынок для беспрецедентного уровня инноваций, что принесет пользу технологическому прогрессу США и послужит новым стимулом для инвестиций в экосистему ИИ. При этом имеются мнения, что Трамп намерен сохранить меморандум Байдена от 24 октября 2024 г. о лидерстве США в сфере ИИ.

Суть «Манхэттенского проекта 2.0»

НАТО 10 июля 2024 г. опубликовала обновленную Стратегию ИИ. Стратегия ИИ основана на концепции, принятой в 2021 г., и учитывает достижения в области технологий ИИ, такие как генеративный ИИ и иные новые инструменты. Стратегия определяет несколько приоритетов, в том числе: продвижение внедрения принципов ответственного использования ИИ; повышение оперативной совместимости между системами ИИ во всем альянсе; сочетание ИИ с другими новыми прорывными технологиями; и расширение экосистемы ИИ НАТО за счет более тесного сотрудничества с промышленностью и академическими кругами союзников, акселератором оборонных инноваций НАТО DIANA, Инновационным фондом НАТО и партнерами-единомышленниками. Стратегия впервые определила дезинформацию на основе ИИ, информационные операции и гендерное насилие как проблемы, вызывающие озабоченность альянса, сообществ и демократий. В рамках стратегии в области ИИ НАТО будет работать над защитой от враждебного использования ИИ, в том числе посредством усиления стратегического прогнозирования и анализа.

С учетом обсуждения проблематики безопасности ИИ на заседаниях Совбеза ООН, Генассамблеи ООН, а также на иных важных международных и региональных площадках, равно как и на фоне очевидных успехов на треке ИИ Китая, партнёры Трампа не раз заявляли о готовности подготовить указ в духе «Манхэттенского проекта» для продвижения технологий ИИ, в интересах национальной безопасности.

В ноябре 2024 года Комиссия по обзору экономики и безопасности США и Китая (USCC ) Конгресса США опубликовала доклад, в котором рекомендовала американским законодателям создать и профинансировать программу по типу «Манхэттенского проекта», направленную на ускоренное развитие общего ИИ.

В настоящее время проекта пока не существует из-за разнообразных проблем: технических, теоретических и экономических. В силу последнего фактора Минфин США в ноябре 2024 года ввел новые ограничения на инвестиции американских венчурных компаний в китайские компании, разрабатывающие модели AGI, а также санкции против Китая, направленные на ограничение его доступа к передовым чипам.

Согласно отчету комиссии, по состоянию на июнь 2024 года 50 компаний в Китае занимались разработкой моделей AGI, тогда как в США, по данным комиссии, лишь небольшое число крупных компаний разрабатывают модели AGI. Создавшая ChatGPT компания OpenAI предложила правительству выделить больше средств на разработку AGI в своем «Инфраструктурном плане для США». OpenAI представляет «Манхэттенский проект» в отношении AGI как один из «знаковых инфраструктурных проектов США, которые продвигают страну вперед».

Милитаризация ИИ технологий США

В то время как Америка обсуждает план инноваций Трампа в сфере ИИ, мир готовится к стрессу. Многие эксперты ожидают, что его план «Сделать Америку первой в области ИИ», в том числе путем расширения экспортного контроля эпохи Байдена против Китая, ускорит гонку вооружений в области ИИ, которая уже идет.

В этом контексте важно отметить, что две ведущие компании США в сфере оборонных технологий Palantir и Anduril 7 декабря 2024 года объявили о создании отраслевого консорциума для устранения препятствий, которые, по их мнению, мешают Минобороны США принять «на вооружение» ИИ.

Следует подчеркнуть, что обе фирмы являются ключевыми игроками в экосистеме ИИ и программном обеспечении Пентагона. Так, Palantir создает платформы для комплексного анализа и обработки данных, а Anduril известна разработками современных аппаратных и программных систем, ориентированных, в том числе на автономность ИИ.

Обе компании работают вместе над программой создания армейской системы доступа к тактической разведке и наведения. Данная система будет использовать ИИ для интеграции и наведения с введением в эксплуатацию в течение ближайших двух лет.

Кроме того, Palantir по контракту 2017 года поставляет программное обеспечение для платформы данных армии, которая помогает лицу, принимающему решение, получать исчерпывающую информацию для управления боевой мощью. Компания Anduril поставляет оборудование и программное обеспечение по проекту Пентагона Replicator, целью которого является развертывание десятков тысяч небольших сетевых беспилотников уже к августу 2025 года.

Пентагон рассчитывает, что массовое использование дронов позволит нивелировать численное превосходство Народно-освободительной армии Китая. В рамках плана Replicator предполагается задействовать беспилотники различных классов: летающие, наземные, надводные, подводные и даже космические. Эти устройства будут способными действовать как индивидуально, так и в группах, даже при отсутствии связи. Основным преимуществом подобной тактики является сохранение жизней военнослужащих, поскольку дроны являются относительно недорогими.

Компании будут развивать свои линейки продуктов: платформу ИИ Palantir, AIP и Menace от Anduril — программно-определяемую систему управления и контроля. Планы партнеров совпали с сообщениями о других отраслевых сотрудничествах с их участием. Так, Anduril заявила об объединении с OpenAI для использования алгоритмов ИИ для улучшения борьбы с дронами, Palantir — с Booz Allen Hamilton для продвижения оборонных инноваций среди союзников США. Цель состоит в устранении проблем, тормозящих внедрение ИИ в Пентагоне: готовность данных и отсутствие безопасного канала для масштабирования отраслевых моделей ИИ.

Именно на решение данных проблем сориентирован законопроект, предложенный сенатором Элизабет Уоррен (демократ от Массачусетса) и сенатором Эриком Шмиттом (республиканец от Миссури). Он содержит поручение Главному управлению по цифровым технологиям и ИИ Пентагона обеспечить безопасность данных, используемых для создания или эксплуатации военных инструментов с применением ИИ.

В ходе специального брифинга главный офицер по цифровым технологиям и ИИ Пентагона Рада Плам заявила, что внедрение технологий ИИ Россией, Китаем и другими соперниками представляет угрозу нацбезопасности США. В силу этого США будут прикладывать все усилия, чтобы обеспечить лидерство в сфере ИИ. В этих целях в Пентагоне начало работу специальное подразделение по ускоренному внедрению ИИ с бюджетом $100 миллионов.

Манхэттенский проект 2.0. – научное мошенничество?

Многие ведущие ученые были встревожены докладом комиссии Конгресса США. Известный астрофизик профессор Массачусетского технологического института и соучредитель Института будущей жизни (FLI) Макс Тегмарк опубликовал на сайте института обращение к правительству США, в котором пишет, что «предложение Манхэттенского проекта по AGI – это научное мошенничество… Сделать это – означало бы вступить в гонку к самоуничтожению».

С Тегмарком согласен ученый-компьютерщик Джеффри Хинтон, который в октябре 2024 года получил Нобелевскую премию по физике за свои работы в области ИИ. Он сразу же выступил с предупреждением о неконтролируемой человеком мощи технологии ИИ. Хинтон, который в свое время ушел из Google, считается одним из крестных отцов ИИ. И хотя Хинтон признает, что ИИ может преобразовать человеческое общество в лучшую сторону, что приведет к «огромному повышению производительности» в таких областях, как здравоохранение, он также подчеркнул потенциал «ряда возможных плохих последствий, в частности, угрозу выхода этих вещей из-под контроля».

Макс Тегмарк, который тесно сотрудничал с Илоном Маском по вопросам ограничения опасностей ИИ, заявил, что влияние Илона Маска на будущую администрацию Трампа может привести к ужесточению стандартной безопасности для ИИ. Маск может помочь избранному президенту осознать, что гонка за ИИ — это «гонка самоубийства». Он также отметил, что поддержка Маском законопроекта SB 1047 в Калифорнии, несмотря на противодействие со стороны многих его коллег-технарей, стала позитивным знаком для сторонников безопасности ИИ.

Маск предупреждал, что безудержное развитие ИИ может иметь катастрофические последствия для человечества и он стал одним из более чем 30 000 подписантов, призывавших приостановить работу над общим ИИ.

Предостережения ведущих ученых относительно угрозы бесконтрольного развития технологий ИИ подтверждаются исследованиями «внутреннего мира» продвинутых моделей чат-ботов. В мае 2024 года группа американских ученых опубликовала доклад «Диссоциация языка и мышления в больших языковых моделях», в котором доказывается, что все модели ИИ руководствуются в своих решениях и действиях лишь логикой, игнорируя эмоции и мораль. Этические нормы – справедливость, непредвзятость, подотчетность, конфиденциальность, объяснимость и доступность – практически игнорируются.

Немецкие учёные из Университета Манхейма применили методы психометрии (методику психологических измерений знаний, способностей, взглядов и качеств личности человека) к оценке психологии ИИ. Итогом стал вывод о необходимости «пожизненного мониторинга психометрических свойств ИИ». Иными словами, они дали понять, что ИИ необходимо держать «на коротком поводке».

Схожие психометрические методики для исследования системы ценностей различных LLM применили учёные из Microsoft Research Asia (MSRA) и Университета Цинхуа, изложив их в препринте «За пределами человеческих норм: раскрытие уникальных ценностей больших языковых моделей посредством междисциплинарных подходов». Американо-китайская команда ученых пришла к выводу, что такие понятия, как «святость», «верность», «гедонизм» и «традиции», мало актуальны для моделей LLM из-за их не основанном на личном опыте обучении, лишенном присущих человеку культурных, религиозных и личных убеждений».

Вывод из этих исследований один – ИИ «бездушен». Именно эта «бездушность» моделей ИИ и мотивировала Пентагон использовать ИИ в системах вооружений, в первую очередь в смертоносных автономных системах вооружений (САС), разработки которых в США стали приоритетными. Военно-промышленный комплекс США выделяет гигантские суммы на создание САС с еще более мощным и непредсказуемым ИИ.

Киберядерные риски ИИ

Оценить, как ИИ может повлиять на ядерную сферу и способствовать непреднамеренной эскалации, — сложнейшая задача. Знакомство с описанием аварий на АЭС «Три-Майл-Айленд» в 1979 году в США и на АЭС Фукусима-1 в Японии в 2011 г. показало, что снижение риска непреднамеренной ядерной эскалации требует новой структуры управления, которая определяла бы пороговые значения для максимально приемлемой вероятности случайного ядерного запуска или пуска ракеты в ядерном оснащении в качестве единого критерия безопасности.

Можно предположить, что ряд государств в целях получения стратегического доминирования рассматривают возможность применения ИИ для модернизации устаревших ядерных запасов. В конечном счете, ответственность за предотвращение непреднамеренной эскалации лежит на обладателях ядерного оружия, независимо от того, полагаются ли их системы командования на дискеты или ИИ. В пользу ИИ — его способность анализировать огромные объемы данных из различных источников неформализованной информации для быстрого выявления угроз, автоматизации идентификации объектов и оценки вариантов кризисного реагирования.

Тем не менее, ИИ несет в себе ряд существенных рисков из-за ограничений, присущих современным его моделям.

- ИИ ненадежен, ибо может генерировать ложную или «отравленную» информацию, которая может привести к ошибочным прогнозам и рекомендациям, что в конечном итоге приведет к неверному решению. Это явление называется «галлюцинациями». Примеров немало: модель, генерирующая неверные факты об исторических событиях, модель зрения, «видящая» объекты, которых нет и т.д.

- ИИ непрозрачен, что создаёт проблему «черного ящика». Нередко система ИИ приходит к своим выводам, что подрывает доверие и снижает полезность ИИ в условиях с высокими ставками, таких как принятие решений в ядерной энергетике.

- Системы ИИ подвержены кибератакам, в т.ч. с использованием ИИ, что создает возможности для противника скомпрометировать целостность систем ядерного командования и управления.

- Современные модели ИИ стараются сопоставить свои результаты с человеческими ценностями и целями, но иногда могут отклоняться от них. Напряженная обстановка при принятии решений в ядерной отрасли в сочетании с ограниченным временем реагирования усугубляет эти опасности.

- Будущие достижения и системы ИИ усугубляют вышеуказанные и порождают новые риски, связанные с новыми системами ИИ.

Синтез «Манхэттонских проектов» — угроза человечеству

13 сентября 2023 г. американская некоммерческая организация, занимающаяся вопросами глобальной безопасности, «Инициатива по сокращению ядерной угрозы» (Nuclear Threat Initiative – NTI) опубликовала доклад на английском и русском языках «Снижение кибер-рисков для ядерного оружия: предложения по итогам российско-американского экспертного диалога». Доклад распространялся по каналам Госдепа и посольств США.

NTI организовала диалог между неправительственными американскими и российскими экспертами по кибер/информационной безопасности и политике в области ядерного оружия. После первых бесед в Москве в 2019 г. о выводах Исследовательской группы NTI по киберядерному оружию был установлен диалог по треку II (негосударственный трек), который продолжался виртуально на пленарных заседаниях и встречах малых групп в 2020 и 2021 годах до начала СВО.

В ходе переговоров были выработаны шесть предложений для правительств США и России по снижению киберрисков для повышения стратегической стабильности и избежания катастрофического применения ядерного оружия.

Анализ доклада, времени его публикации, а также состава американских участников диалога позволяет сделать вывод о том, что это была многоцелевая провокация в силу следующих причин:

— Россия подписала Договор о всеобъемлющем запрещении ядерных испытаний (ДВЗЯИ) в 1996 г. и ратифицировала в 2000-м.

— США подписали договор, но не ратифицировали.

Таким образом, между Россией и США сложился дисбаланс относительно объема обязательств по договору, что для международной обстановки на тот период времени было недопустимо. Подтверждением этому тезису стали опубликованные CNN в сентябре 2023 г. спутниковые снимки за период с 2018 по 2023 гг., которые свидетельствовали о том, что Китай, Россия и США приступили к модернизации своих ядерных полигонов.

5 октября 2023 г. президент Владимир Путин заявил, что Россия может отозвать ратификацию договора, 18 октября 2023 г Госдума РФ приняла законопроект об отмене российской ратификации ДВЗЯИ, а 2 ноября 2023 г. его утвердил Президент В.В.Путин.

Доклад был издан (после двухгодового молчания!) 13 сентября 2023 г., всего сутки спустя после того, как Минобороны США опубликовало несекретную часть своей новой киберстратегии. С учетом прорывных технологий ИИ нельзя исключать появление в США разработок по глобальному мгновенному кибер-ядерному удару (в развитие концепции «Глобальный мгновенный удар»).

Таким образом, синтез «Манхэттонского проекта» и «Манхэттонского проекта 2.0» — способен стать прямым путем человечества в Армагеддон.

***

В качестве ответа на вызовы «Манхэттонского проекта 2.0», которые указаны в статье, стоит привести материалы XXI заседания Международного дискуссионного клуба «Валдай» 4-7 ноября 2024 г., где состоялась отдельная сессия на тему «Искусственный интеллект – революция или мода?», в котором принял участие и выступил президент В.Путин. Он подчеркнул: «.. искусственный интеллект – это важнейший инструмент развития. И один из наших приоритетов прежде всего, конечно, в сфере экономики, но не только, и в других областях, в использовании больших данных…».

11 декабря 2024 г. на площадке Сбер Владимир Путин принял участие в международной конференции «Путешествие в мир искусственного интеллекта». Своё выступление он завершил словами: «Уверен, что серьёзный импульс такому сотрудничеству придаст международный Альянс национальных ассоциаций и институтов развития в сфере искусственного интеллекта стран БРИКС, других заинтересованных государств. Старт работе такого Альянса дадим уже сегодня на конференции «Путешествие в мир искусственного интеллекта». Рассчитываю, что к этому мероприятию будут присоединяться и новые иностранные участники, в том числе и мои коллеги – первые лица государств».

Приглашение иностранным лидерам, в том числе в США, направлено. Международный альянс в сфере ИИ ждет ответа.